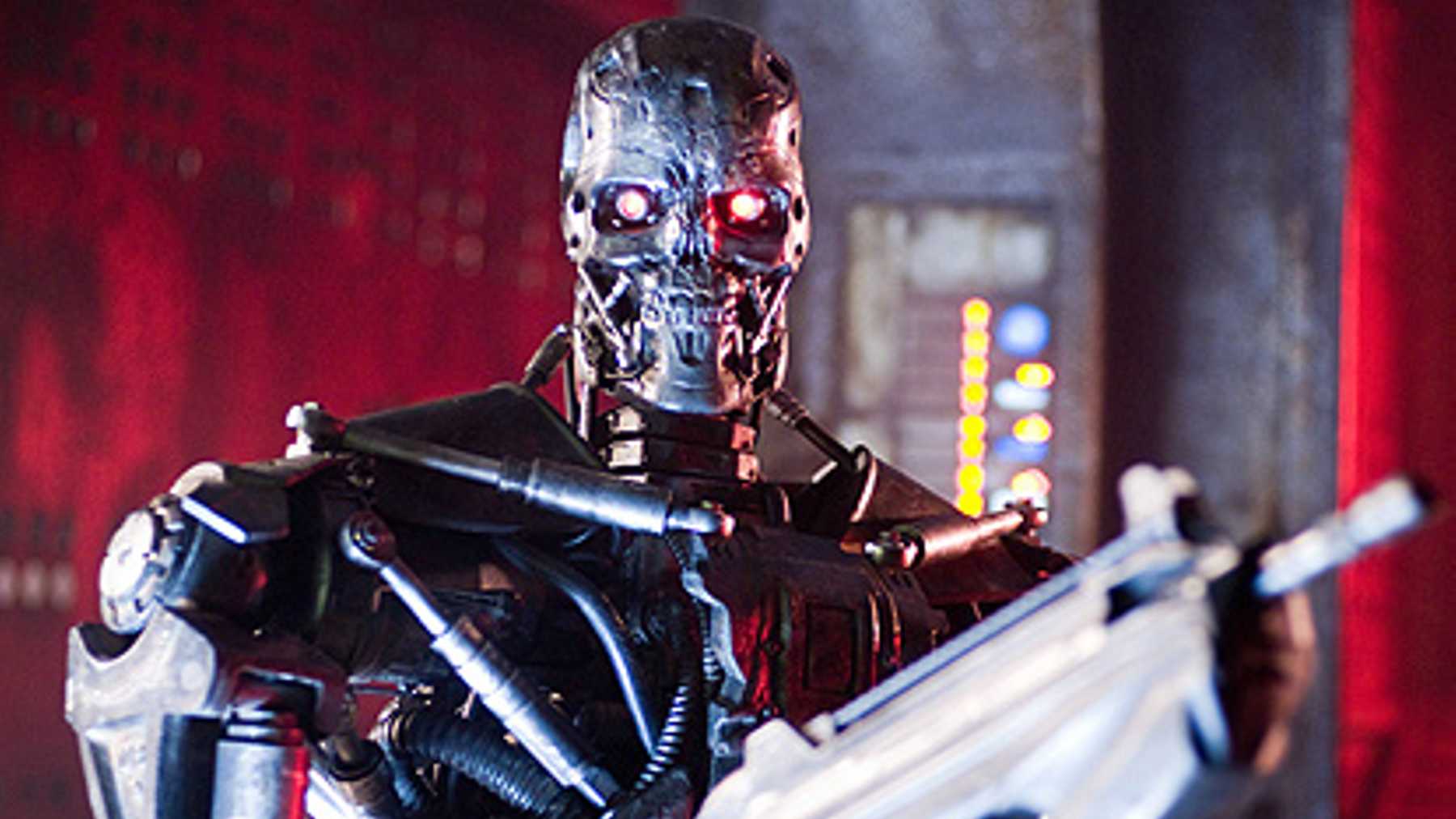

Roboții ucigași controlați de inteligență artificială devin realitate

Reglementarea utilizării inteligenței artificiale în sistemele de armament a fost cerută de Austria.

Având în vedere că tehnologia inteligenței artificiale avansează rapid, sistemele de armament care ar putea ucide fără intervenția umană sunt tot mai aproape, ceea ce ridică provocări etice și juridice despre care majoritatea țărilor spun că trebuie abordate în curând.

„Nu putem lăsa să treacă acest moment fără să luăm măsuri. Acum este momentul să convenim asupra unor reguli și norme internaționale pentru a asigura controlul uman”, a declarat ministrul austriac de Externe, Alexander Schallenberg, în cadrul reuniunii organizațiilor non-guvernamentale și internaționale, precum și atrimișilor din 143 de țări.

„Cel puțin să ne asigurăm că decizia cea mai profundă și de mare anvergură, cine trăiește și cine moare, rămâne în mâinile oamenilor și nu ale mașinilor”, a spus el în discursul de deschidere a conferinței intitulate ”Humanity at the Crossroads: Autonomous Weapons Systems and the Challenge of Regulation”.

Anii de discuții la Națiunile Unite au produs puține rezultate tangibile, iar mulți participanți la conferința de două zile de la Viena au declarat că fereastra de acțiune se închide rapid. „Este atât de important să acționăm și să acționăm foarte repede”, a declarat președintele Comitetului Internațional al Crucii Roșii, Mirjana Spoljaric, în cadrul unei dezbateri la conferință.

„Ceea ce vedem astăzi în diferitele contexte de violență sunt eșecuri morale în fața comunității internaționale. Și nu vrem să vedem astfel de eșecuri accelerând prin acordarea responsabilității pentru violență, pentru controlul asupra violenței, mașinilor și algoritmilor”, a adăugat ea. Inteligența artificială este deja folosită pe câmpul de luptă. Dronele din Ucraina sunt concepute pentru a găsi singure drumul spre țintă atunci când tehnologia de bruiaj a semnalului le întrerupe legătura cu operatorul lor, spun diplomații.

Identificarea țintelor cu inteligență artificială

Luna aceasta, Statele Unite au declarat că analizează un raport al presei potrivit căruia armata israeliană a

folosit inteligența artificială pentru a ajuta la identificarea țintelor din Gaza.

„Am văzut deja inteligența artificială făcând erori de selecție în moduri atât mari, cât și mici, de la

recunoașterea greșită a cheliei unui arbitru ca fiind o minge de fotbal, până la pietoni decedați din cauza unor

mașini care se conduc singure și care nu pot recunoaște traversarea neregulamentară”, a declarat Jaan Tallinn,

programator de software și investitor în tehnologie, într-un discurs de prezentare. „Trebuie să fim extrem de precauți atunci când ne bazăm pe acuratețea acestor sisteme, fie în sectorul militar,

fie în cel civil”, a mai spus acesta, conform Reuters.